近日, 计算机视觉领域国际顶级会议 IEEE/CVF Conference on Computer Vision and Pattern Recognition(CVPR 2026)公布论文录用结果。我院齐林副教授为通讯作者、2024级硕士研究生史宇龙为第一作者的研究成果《Tell2Adapt: A Unified Framework for Source-Free Unsupervised Domain Adaptation via Vision Foundation Model》被大会录用。

CVPR是计算机视觉领域公认的国际顶级会议(CCF A类),每年吸引全球众多顶尖科研工作者投稿,其录用论文指引着计算机视觉领域前沿方向。根据权威的Google Scholar Citation最新统计,CVPR的H5 index为450,在全球所有学术出版物中排名第二,仅次于《Nature》杂志。据大会官方统计,今年全球共有16,092篇有效投稿,最终录用率仅为 25.42%。

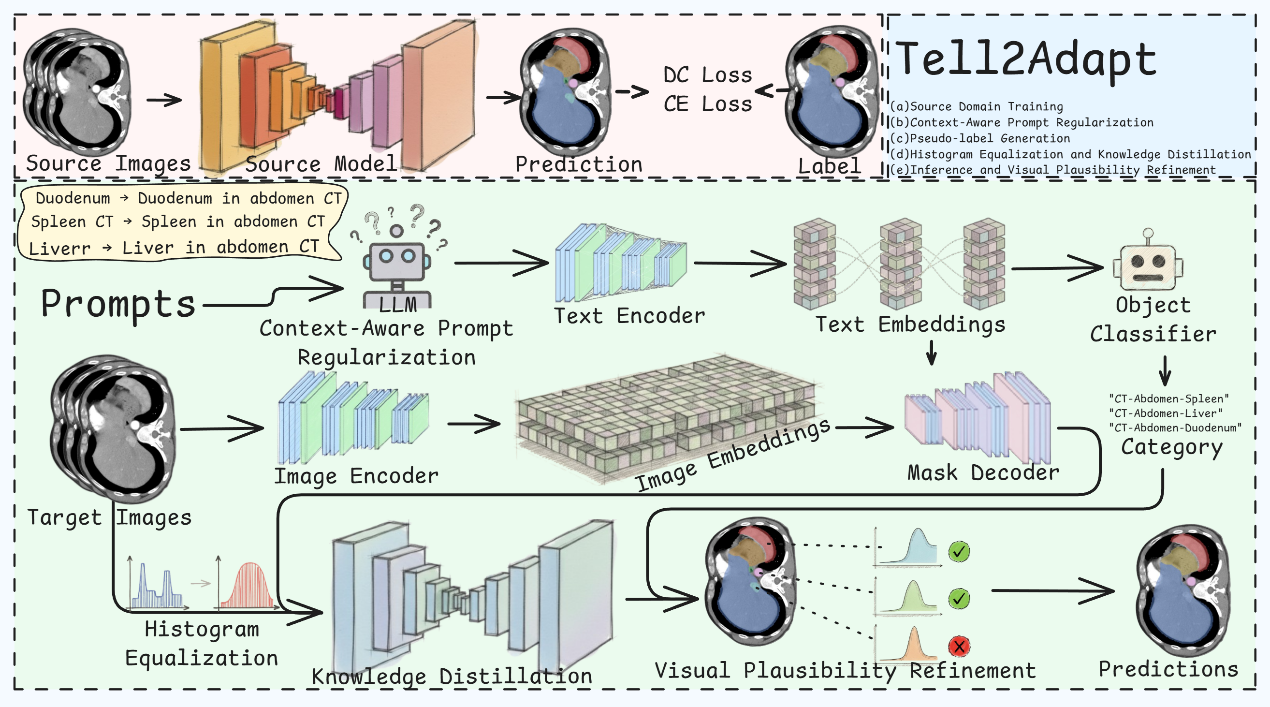

图1 方法总体框架

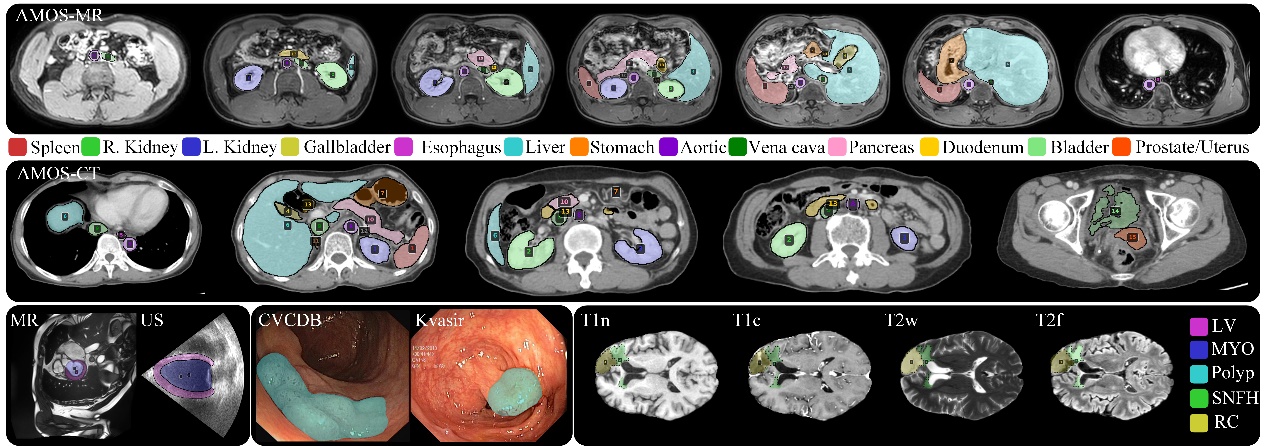

在人工智能技术快速发展的背景下,深度学习模型在医学影像分析中取得显著成果。然而,模型往往依赖大量临床医学标注数据,并在不同医学数据分布之间存在显著域偏移问题。特别是在隐私保护日益严格的现实场景中,源数据不可访问已成为常态,这对传统领域自适应方法提出了巨大挑战。如何在无法访问源数据的前提下,实现模型向新的医疗场景和医学数据的有效迁移,成为当前研究热点问题。针对上述挑战,该论文创新地提出了一种基于视觉基础模型的全新统一框架,用于有效解决域偏移问题。

图2 可视化结果

齐林副教授团队一直在多模态医学影像分析、无感生理信号测量等领域开展研究工作,近期相关成果发表在IEEE/CVF Conference on Computer Vision and Pattern Recognition、IEEE Transactions on Instrumentation and Measurement、IEEE Transactions on Consumer Electronics、IEEE Journal of Biomedical and Health Informatics、Information Fusion、Computer Methods and Programs in Biomedicine等国际知名期刊及会议。